«iuqerfsodp9ifjaposdfjhgosurijfaewrwergwea.com»: cuando un dominio de 10 dólares frenó una pandemia digital

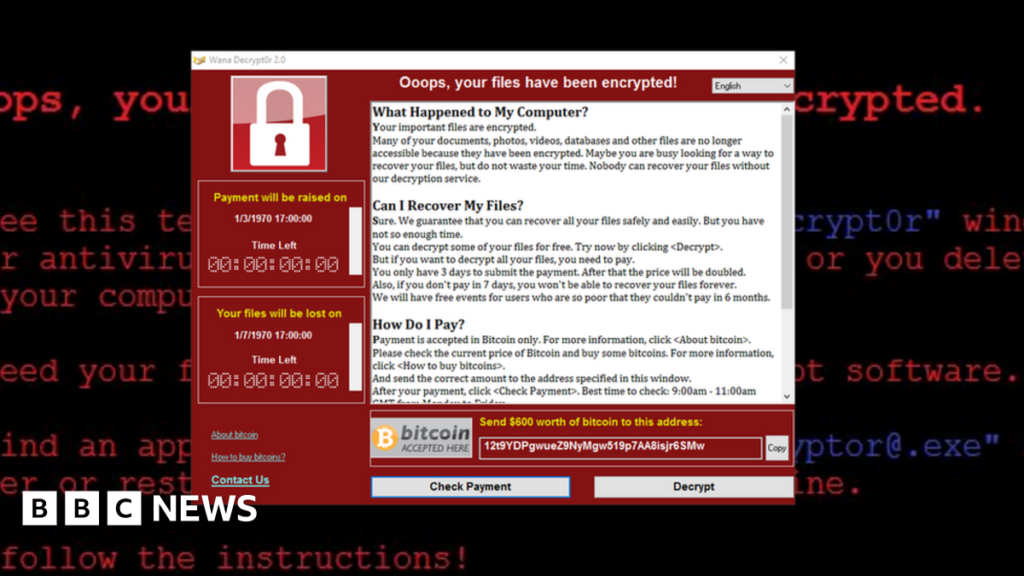

En mayo de 2017 el mundo fue testigo de uno de los ciberataques más impactantes de la historia. Miles de organizaciones en decenas de países vieron cómo sus sistemas informáticos quedaban bloqueados de forma repentina por un ransomware llamado WannaCry. Hospitales, empresas de telecomunicaciones, fábricas, universidades y organismos públicos se encontraron con sus archivos cifrados y una exigencia de rescate en bitcoins para recuperarlos. Durante unas horas pareció que Internet estaba asistiendo a una especie de pandemia digital capaz de expandirse sin control.

Lo que hacía especialmente peligroso a WannaCry era que no dependía de la torpeza de los usuarios. La mayoría de los programas maliciosos necesitan que alguien abra un archivo adjunto, pulse sobre un enlace o instale una aplicación infectada. WannaCry era diferente, pues hacía uso de una vulnerabilidad de Windows conocida como MS17-010 para propagarse automáticamente de un ordenador a otro. Dicha vulnerabilidad afectaba (y afecta, si no está parcheada) al protocolo SMBv1, el mecanismo utilizado por Windows (en su primera versión) para compartir archivos, impresoras y recursos en general dentro de una red. Gracias a ella, un atacante podía ejecutar código de forma remota en una máquina vulnerable sin necesidad de autenticarse ni de que el usuario realizara ninguna acción.

La herramienta que aprovechaba esta vulnerabilidad era un exploit denominado EternalBlue. Lo más sorprendente es que EternalBlue no había sido desarrollado por un grupo criminal cualquiera, sino por la propia Agencia de Seguridad Nacional de Estados Unidos, la NSA. Durante años fue una herramienta secreta utilizada con fines de inteligencia hasta que acabó filtrada al público por un misterioso grupo conocido como The Shadow Brokers. De repente, una de las armas digitales más sofisticadas del arsenal de una agencia gubernamental quedó al alcance de cualquiera que quisiera utilizarla.

Cuando WannaCry apareció en Internet (viernes, 12 de mayo de 2017), combinó dicho exploit EternalBlue con un ransomware tradicional, y el resultado fue devastador. Una vez que una máquina era infectada, comenzaba a escanear la red en busca de otros equipos vulnerables. Si encontraba alguno, lo comprometía automáticamente y repetía el proceso. Este comportamiento convirtió a WannaCry, además, en un gusano informático, una categoría especialmente peligrosa de malware porque puede expandirse por sí mismo sin intervención humana y, en aquel entonces, en cuestión de horas se registraron decenas de miles de infecciones en más de ciento cincuenta países.

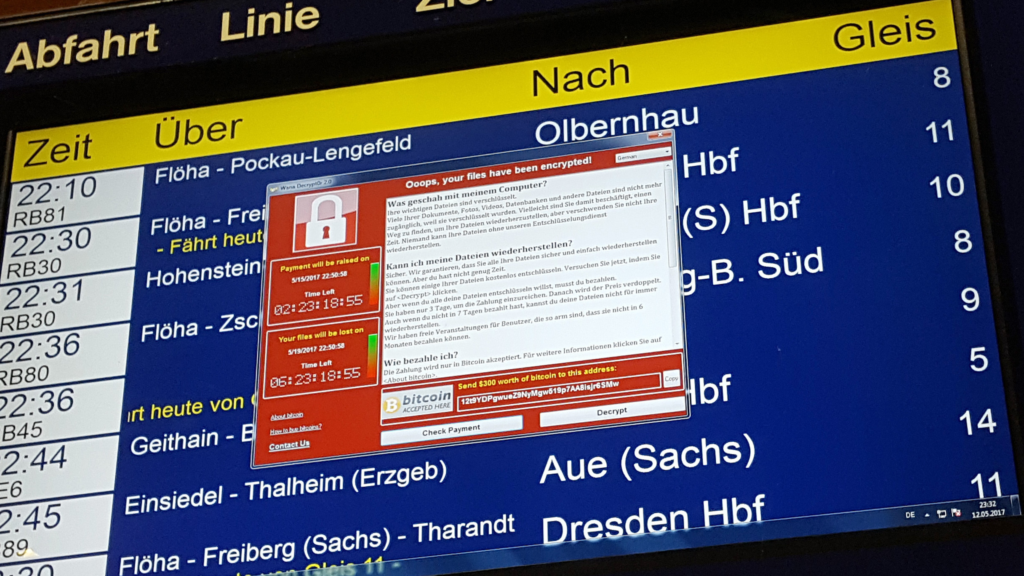

Entre las víctimas más conocidas estuvo el Servicio Nacional de Salud británico. Numerosos hospitales tuvieron que cancelar operaciones y consultas porque sus sistemas informáticos quedaron inutilizados, y también resultaron afectadas grandes empresas industriales, compañías de telecomunicaciones y organismos gubernamentales. Las imágenes de pantallas mostrando el mensaje de rescate dieron la vuelta al mundo y generaron una sensación de vulnerabilidad pocas veces vista hasta entonces.

Sin embargo, cuando todo parecía fuera de control, ocurrió algo inesperado. Un joven investigador británico de seguridad informática llamado Marcus Hutchins, conocido en Internet por el alias MalwareTech, comenzó a analizar una muestra del ransomware para comprender su funcionamiento. Durante su investigación, Hutchins observó un comportamiento extraño. Descubrió que, antes de iniciar el cifrado de archivos o de comenzar su propagación, WannaCry intentaba contactar con un extraño dominio de nombre aparentemente aleatorio: iuqerfsodp9ifjaposdfjhgosurijfaewrwergwea.com.

La mayoría de los investigadores habría considerado aquel detalle como una simple curiosidad técnica, pero Hutchins, intrigado por su presencia en el código fuente, decidió registrar aquel dominio para estudiar el tráfico que pudiera recibir. El coste fue insignificante, apenas unos pocos dólares, pero lo que ocurrió después sorprendió a todo el mundo. Una vez que el dominio comenzó a responder, las nuevas instancias de WannaCry dejaron de ejecutarse. Sin saberlo, Hutchins había activado un mecanismo oculto dentro del software malicioso que actuaba como un interruptor de apagado, conocido popularmente como kill switch. Si la conexión fallaba, el malware continuaba ejecutándose normalmente; si la conexión tenía éxito, se detenía.

La razón exacta por la que los autores incluyeron este mecanismo sigue siendo objeto de debate. La teoría más aceptada es que pretendían dificultar el análisis del malware en entornos de laboratorio, ya que muchos sistemas automáticos utilizados por investigadores responden positivamente a cualquier petición DNS o HTTP realizada por un programa sospechoso con el objeto de observar su comportamiento. Los desarrolladores de WannaCry podrían haberlo diseñado para que se detuviera si conseguía contactar con aquel dominio, asumiendo que eso significaba que estaba siendo ejecutado dentro de una sandbox de análisis. Lo que no imaginaron es que a alguien le diera por registrar el dominio (o sí, quién sabe) y provocaría que todas las nuevas infecciones interpretaran que debían detenerse.

Es importante señalar que el hallazgo no eliminó el ransomware de los equipos ya comprometidos ni recuperó los archivos cifrados. Los sistemas infectados continuaron afectados. Sin embargo, el descubrimiento sí que logró frenar la propagación masiva que estaba alimentando el crecimiento exponencial del ataque. En otras palabras, se cerró la principal vía por la que la epidemia digital seguía expandiéndose.

El caso WannaCry también dejó al descubierto una realidad incómoda. Microsoft había publicado el parche que corregía la vulnerabilidad dos meses antes del ataque. A pesar de ello, miles de organizaciones no habían actualizado sus sistemas. Muchas utilizaban versiones antiguas de Windows o mantenían configuraciones obsoletas por motivos de compatibilidad. El resultado fue que una vulnerabilidad conocida y corregida acabó convirtiéndose en la puerta de entrada de una de las mayores crisis de seguridad informática de la década.

Con el paso del tiempo, WannaCry se ha convertido en un ejemplo clásico de cómo múltiples factores pueden combinarse para producir una tormenta perfecta: una vulnerabilidad grave, una herramienta ofensiva filtrada desde una agencia gubernamental, miles de sistemas sin actualizar y un malware diseñado para propagarse automáticamente fueron los ingredientes de un incidente histórico. Sin embargo, también es recordado por una circunstancia casi surrealista, la de que una crisis global que amenazaba con paralizar infraestructuras críticas terminó siendo frenada, al menos en gran medida, gracias al registro de un dominio olvidado que costó menos que una comida rápida.

Pocas veces en la historia de la informática una decisión tan simple tuvo un impacto tan enorme. Mientras miles de expertos intentaban comprender qué estaba ocurriendo y gobiernos de todo el mundo activaban protocolos de emergencia, un investigador sentado frente a su ordenador acabó encontrando la pieza que detuvo la expansión del ataque. Es una historia que parece sacada de una novela ciberpunk, pero ocurrió de verdad. Y, quizás por ello, WannaCry sigue siendo, casi una década después, uno de los episodios más fascinantes de la historia de la ciberseguridad.

La jungla de los cibercafés del cambio de milenio

Antes de que proliferaran los espacios de coworking llenos de MacBooks plateados y café de especialidad, existieron unos emplazamientos de culto y perdición conocidos como cibercafés, lugares extraños, oscuros y ligeramente decadentes donde convivían gamers jugando al ‘Counter-Strike’, chavales descargando nuevas ROM de Neo Geo, universitarios imprimiendo trabajos cinco minutos antes de entregarlos y personajes bastante sospechosos, que parecían llevar allí sentados desde siempre, copiando comandos del recién aparecido Nmap en un artículo de la revista ‘Phrack Magazine’.

Durante unos años, ya irrepetibles, los cibercafés fueron el verdadero corazón físico de la cultura underground de Internet. Reconvertidos de los antiguos locutorios pero con el tufillo de las salas de recreativos de los años ochenta, entrar en uno de aquellos locales era acceder a una dimensión paralela. El olor era una mezcla de tabaco incrustado en las paredes, plástico caliente de monitores CRT y comida recalentada. El sonido dominante era un caos glorioso compuesto por ventiladores de Pentium III, teclados mecánicos baratos aporreados con violencia y el ruido inconfundible de decenas de partidas de ‘Quake III Arena’ simultáneas. Había pantallas por todas partes mostrando escritorios de Windows 98, Windows 2000 o XP llenos de iconos sospechosos y salvapantallas de ‘The Matrix’.

Muchos cibercafés empezaron simplemente ofreciendo acceso a Internet por horas, algo revolucionario en una época en la que la mayoría de la gente todavía navegaba mediante módems de 56K (los más afortunados) pagando a precio de oro las llamadas telefónicas. Poder conectarte con ADSL o RDSI era casi ciencia ficción. Pero rápidamente aquellos sitios evolucionaron hacia algo mucho más importante: se convirtieron en puntos de encuentro de la escena informática underground. Allí se compartían cedés grabados, herramientas, tutoriales, cracks, exploits y conocimientos técnicos que rara vez aparecían en sitios «oficiales».

Las máquinas eran auténticas bestias para la época: torres de color beis gigantescas con pegatinas de NVIDIA, Sound Blaster o Iomega, monitores de tubo con un culo enorme de 17 pulgadas capaces de freírte la retina o ratones ópticos recién llegados que sustituían lentamente a los de bola y su acumulación incesante de pelusas. Y debajo del escritorio, casi siempre, una maraña infernal de cables ethernet conectados a hubs o switches que parpadeaban constantemente. Algunos locales más avanzados montaban auténticas LAN parties permanentes con redes a 100 Mbps que parecía tecnología militar comparada con el Internet doméstico de aquel entonces.

Pero el verdadero espectáculo ocurría dentro de los sistemas operativos. Muchas máquinas estaban completamente destrozadas tras semanas de uso salvaje, de barras de herramientas imposibles instaladas en Internet Explorer, de Kazaa ejecutándose permanentemente en segundo plano, de Winamp reproduciendo trance alemán y de carpetas compartidas llenas de material dudoso, muy dudoso. Los administradores vivían una guerra constante intentando limpiar virus, troyanos y spyware. Y perdían siempre.

Porque sí, los cibercafés eran auténticos laboratorios biológicos de malware. Disquetes, discos CD-ROM y memorias USB pasaban de una máquina a otra infectando todo lo que encontraban. Gusanos como Blaster, Sasser o Mydoom campaban a sus anchas por redes locales mal configuradas, mientras Norton y Panda consumían más de la mitad de la RAM de los equipos intentando contener el desastre. Muchas veces bastaba con sentarte en un PC para heredar veinte troyanos distintos en menos de media hora.

Y aun así, precisamente por ese caos, muchísima gente aprendió allí cómo funcionaban realmente los ordenadores. Los cibercafés eran universidades no oficiales de los bajos fondos digitales. El típico muchacho que iba inicialmente a jugar en línea terminaba descubriendo el correo electrónico y Eudora, luego aprendía a usar un FTP pirata, después comenzaba a tocar scripts de mIRC y acababa investigando sobre redes, Linux o programación en C. Existía una transmisión constante de conocimiento informal entre usuarios; todo el mundo enseñaba algo a alguien.

Los administradores de los cibercafés eran personajes fascinantes. Algunos parecían simples dueños de negocio, pero otros claramente habían salido de la BBS ‘Galletas’ o de algún oscuro grupo de la jerarquía alt.* de Usenet. Lo mismo reinstalaban un Windows XP en veinte minutos, que crimpaban cables RJ45 como si fueran cirujanos o mantenían en orden sus colecciones absurdas de cederrones grabados con utilidades, drivers y software pirata. Eran individuos que miraban siempre hacia otro lado.

Había también una dimensión social muy peculiar, y es que mucha gente vivió sus primeras experiencias reales en Internet desde un cibercafé: primeras partidas online interminables de ‘Age of Empires II’ en red local, primeras descargas eternas de eMule, primeras conversaciones en IRC o primeros ligues digitales con nicks de todo punto disparatados en Terra Chat o LatinChat, donde media adolescencia descubrió que hablar con desconocidos a través de una pantalla resultaba muchísimo más fácil que hacerlo cara a cara. Mucha gente creó allí su primer correo electrónico, abrió su primera cuenta de Messenger o descubrió por primera vez que existían comunidades enteras de personas obsesionadas con exactamente las mismas rarezas que ellos.

La escena española de principios de siglo estaba profundamente ligada a estos sitios. En España, a mediados de la década de 1990, abrió en Oviedo el establecimiento ‘Laser Internet Center’, descrito por la agencia Europa Press como el primer local dedicado al acceso público a Internet del país. En ese mismo periodo surgieron, en ciudades como Madrid, locales orientados al ocio tecnológico que popularizaron el término «cibercafé» en su sentido social. Allí circulaban decenas de CD de Wifislax antes de que la gente supiera siquiera qué era GNU/Linux, allí se compartían versiones modificadas de programas, paquetes de exploits, tutoriales para romper WEP y colecciones gigantescas de software descargado mediante Direct Connect o eDonkey. Algunos cibercafés incluso tenían pequeñas redes internas clandestinas para compartir archivos localmente a velocidades descabelladamente rápidas (para la época).

Con la llegada del ADSL barato y la expansión del Internet doméstico, muchos cibercafés empezaron a desaparecer, ya que no tenía sentido pagar por conectarte cuando cualquiera podía tener banda ancha en casa a un precio fijo —la conocida como «tarifa plana»— . Después llegaron Steam, Discord y las redes sociales modernas, que terminaron de matar aquella cultura física y local.

Pero durante unos años gloriosos y caóticos, los cibercafés fueron mucho más que negocios. Fueron pequeños nodos cyberpunk donde nació gran parte de la cultura informática underground de toda una generación.

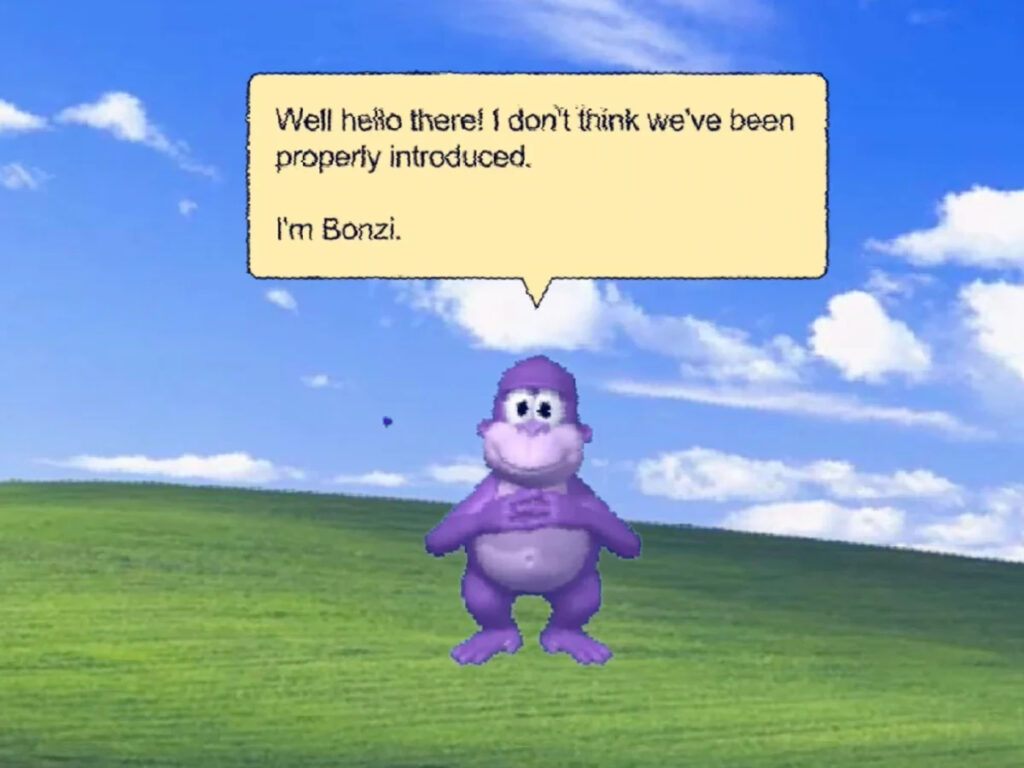

BonziBuddy: el mono morado que sonreía mientras destrozaba tu PC

Hubo un tiempo en el que instalar cualquier programa descargado de Internet parecía una idea perfectamente razonable. Nadie hablaba todavía de sandboxing, ni de permisos peligrosos, ni de telemetría invasiva. Windows apenas protegía al usuario de sí mismo y la mayoría de la gente ejecutaba archivos .EXE descargados desde páginas llenas de imágenes GIF parpadeantes sin hacerse demasiadas preguntas. En medio de aquel ecosistema delirante apareció una de las criaturas más extrañas y memorables de toda la Internet de finales de los noventa: BonziBuddy, el infame mono morado que durante unos años se infiltró en millones de ordenadores domésticos disfrazado de asistente virtual simpático.

A primera vista parecía completamente inofensivo. BonziBuddy se presentaba como una especie de ayudante inteligente para Windows, una mascota digital capaz de hablar, contar chistes, leer texto en voz alta y acompañar al usuario mientras navegaba por Internet. Visualmente era imposible olvidarlo: un gorila tridimensional de color púrpura que aparecía en el escritorio realizando animaciones absurdas mientras una voz sintética metálica saludaba al usuario con entusiasmo inquietante. En teoría, aquello era simplemente entretenimiento interactivo; en la práctica terminó convirtiéndose en uno de los ejemplos más claros de cómo la ingeniería social empezaba a dominar Internet muchísimo antes de que el término malware se popularizara entre el gran público.

La ciencia detrás de BonziBuddy representaba perfectamente el optimismo extraño de aquella época. El programa utilizaba Microsoft Agent, una tecnología desarrollada por el gigante de Redmond para crear personajes animados capaces de interactuar con el usuario mediante síntesis de voz. Era de la misma familia tecnológica de Clipo (Clippy, en inglés), el famoso clip de Office que interrumpía constantemente mientras escribías documentos dando golpecitos en el monitor, pero llevada a un extremo muchísimo más agresivo. En un momento donde tener elementos tridimensionales moviéndose por el escritorio parecía casi ciencia ficción, BonziBuddy impresionaba muchísimo a los usuarios domésticos. Hay que recordar el contexto: la gente personalizaba Windows con skins imposibles, barras transparentes, cursores animados y efectos visuales absurdos. Internet estaba llena de software experimental, caótico y profundamente hortera. BonziBuddy encajaba perfectamente dentro de aquella estética.

El problema era que el mono hacía bastantes más cosas, aparte de contar chistes malos. Poco a poco los usuarios empezaron a descubrir que el programa recopilaba información del sistema, monitorizaba hábitos de navegación y bombardeaba constantemente al usuario con publicidad y recomendaciones sospechosas. BonziBuddy actuaba como una especie de spyware primitivo disfrazado de mascota amigable. Hoy probablemente sería detectado inmediatamente por cualquier antivirus moderno pero, a principios de los 2000, la línea entre programa gratuito, adware y malware era extremadamente difusa. Muchísima gente ni siquiera sabía que existían diferencias reales entre esos conceptos. Si algo era gratis y funcionaba, bastaba.

Y ahí residía precisamente el verdadero genio perverso del programa. Técnicamente BonziBuddy no era un virus clásico, no destruía archivos ni explotaba vulnerabilidades sofisticadas del sistema operativo. Funcionaba usando algo muchísimo más eficaz: manipulación psicológica. El usuario instalaba el programa voluntariamente convencido de que estaba obteniendo una herramienta divertida o útil. Una vez dentro del sistema, el mono se convertía en una presencia constante y pegajosa. Modificaba configuraciones, añadía procesos al arranque, instalaba componentes adicionales y aparecía continuamente reclamando atención. El software no «hackeaba» Windows; «hackeaba» directamente el comportamiento humano.

La experiencia de convivir con BonziBuddy era profundamente extraña. Encendías el ordenador familiar y ahí estaba él, moviéndose lentamente sobre el escritorio CRT mientras el ventilador del Pentium III sonaba como un secador industrial. De repente una voz sintética espantosa lanzaba algún comentario absurdo o intentaba iniciar interacción contigo sin haberla pedido. Visto hoy resulta casi perturbador, y es que hay algo genuinamente inquietante en recordar aquellos asistentes digitales primitivos intentando comportarse como compañeros virtuales amistosos mientras recopilaban datos silenciosamente de fondo. BonziBuddy pertenecía a una época concreta de Internet donde el software todavía tenía una personalidad exagerada, caótica y ligeramente amenazante.

El programa además empezó a distribuirse empaquetado junto a otras aplicaciones gratuitas. Descargabas un reproductor MP3, un paquete de iconos, un gestor de descargas o cualquier utilidad shareware obtenida desde páginas sospechosas y, sin darte demasiada cuenta, terminabas instalando también el mono morado. Fue uno de los grandes precursores de la cultura del bundle basura que después invadiría Internet durante años. Muchas infecciones domésticas de principios de los 2000 empezaban precisamente así, como una instalación aparentemente inocente que acababa llenando Windows de barras de herramientas, spyware y programas residentes imposibles de eliminar completamente.

Las máquinas domésticas de la época sufrían especialmente con este tipo de software. Windows 95, 98, ME e, incluso, XP tenían arquitecturas bastante frágiles comparadas con los sistemas modernos. La gestión de memoria era limitada, la estabilidad general dejaba muchísimo que desear y cualquier programa residente adicional podía convertir el ordenador en un desastre lento e impredecible. BonziBuddy consumía recursos constantemente mientras convivía con ‘Kazaa’, ‘eMule’, ‘Winamp’, ‘Internet Explorer’ a tope de toolbars y una colección de procesos extraños ejecutándose en el inicio del sistema. Muchos pecés domésticos funcionaban permanentemente al borde del colapso total.

Lo fascinante es que BonziBuddy terminó convirtiéndose en símbolo de una Internet muchísimo más salvaje y experimental que la actual. Una red donde cualquiera podía distribuir software, donde nadie verificaba demasiado nada y donde instalar ejecutables aleatorios formaba parte normal de la experiencia digital. Era un ecosistema profundamente inseguro, sí, pero también increíblemente libre y caótico. Los usuarios aprendían seguridad informática precisamente después de infectar el ordenador varias veces, no antes.

Con el tiempo, Bonzi Software —la compañía detrás el engendro— terminó enfrentándose a denuncias y problemas legales relacionados con privacidad y publicidad engañosa. Poco a poco el mono desapareció de Internet, pero dejó una huella extrañísima en la memoria colectiva de toda una generación.

Hoy ver una captura de BonziBuddy provoca una mezcla muy concreta de nostalgia y terror tecnológico. Porque el mono morado no fue simplemente un programa molesto, fue uno de los primeros grandes ejemplos de algo que hoy domina Internet completamente, esto es, el software diseñado para explotar psicológicamente al usuario mientras finge ser su amigo. Y quizá lo más inquietante de todo es pensar que, en el fondo, gran parte de la Internet moderna sigue funcionando exactamente igual. Sólo que ahora los monos morados son muchísimo más sofisticados.

La web más antigua que sigue en funcionamiento

Si hoy entras en cualquier página moderna —llena de animaciones, vídeos que se reproducen solos y botones que parecen proyectados por un comité de diseñadores con exceso de cafeína— es fácil olvidar que el concepto de «página web» nació siendo poco más que un documento de texto con enlaces azules. Sin embargo, entre esa maraña de sitios modernos, existe un pequeño grupo de webs prehistóricas que se niegan a morir. Son auténticos fósiles digitales, testigos silenciosos de cuando Internet hacía ruidos, costaba dinero por minuto y la mitad del tiempo no funcionaba. Y entre todas ellas, una destaca con un aura casi mística y que sigue siendo la web funcional más antigua del mundo.

La historia suele recordar a info.cern.ch, el primer sitio web de la historia, creado por Tim Berners‑Lee y puesto en línea el 6 de agosto de 1991, como la puerta oficial de la recién nacida World Wide Web. Aunque sigue accesible hoy en día, lo que se conserva es una reconstrucción del original y no su hosting primitivo continuo. Es, sin duda, un museo esencial del origen de Internet, pero no puede considerarse la web en funcionamiento continuo más antigua.

Para encontrar la auténtica veterana que nunca se ha caído del mapa, hay que retroceder todavía más, a una época anterior al propio concepto de WWW. A mediados de los años ochenta, cuando HTML ni existía, cuando las páginas web no eran páginas porque directamente no había web, y cuando nadie tenía la más mínima idea de que Internet se convertiría en el monstruo planetario que es hoy, una pequeña empresa decidió registrar un dominio sin sospechar que acababa de crear un pedazo de historia. Ese dominio era itcorp.com, registrado el 18 de septiembre de 1986 por la empresa Interrupt Technology Corp.

Lo curioso es que este sitio nació en una época en la que tener una página web no tenía ningún propósito práctico, porque, simplemente, no existían las páginas web tal como las entendemos. Para colmo, su aspecto actual no ha cambiado prácticamente desde que se creó: un texto mínimo, una especie de tarjeta de visita espartana en HTML primitivo y un mensaje casi humorístico, reconociendo que la página existe sólo para satisfacer la expectativa de que un dominio tenga una web. Y es exactamente eso, un sitio creado con la misma ilusión con la que uno imprime un folleto por obligación burocrática, pero que terminó convirtiéndose en un monumento histórico sin quererlo.

Resulta especialmente irónico que este fósil digital sea anterior incluso al nacimiento público de la World Wide Web, que no vería la luz hasta cinco años después. En otras palabras, itcorp.com es una web que existía antes de que existieran las webs. Una pieza de Internet tan antigua que, para registrarla, ni siquiera había un sistema formal, pues, según los archivos históricos, había que llamar por teléfono al administrador del sistema de nombres de dominio para pedirlo personalmente, como quien pide una cita presencial en la administración estatal de turno.

Lo maravilloso es que sigue ahí, viva, accesible, inmutable, como un meteorito digital flotando en un universo que ya no se parece en nada al que lo vio nacer. Mientras el resto del Internet ha evolucionado hacia diseños responsivos, inteligencia artificial omnipresente y anuncios que te persiguen aunque no pienses en ellos, este sitio permanece intacto, ignorando cualquier moda o tecnología. Es una cápsula del tiempo funcionando exactamente igual que el primer día.

Al visitar esta reliquia, uno siente una mezcla extraña entre ternura, fascinación y una punzada de nostalgia por un Internet más inocente, donde lo importante era simplemente estar ahí, no impresionar a nadie. Porque si algo nos enseña la existencia de itcorp.com, es que, a veces, la historia la escriben los que hacen las cosas antes de que tengan sentido, casi por accidente. Un gesto simple, casi banal, que termina siendo una huella imborrable.

Por lo tanto, una página que se adelantó a su propia época por pura casualidad y que, casi cuatro décadas después, sigue en pie como la veterana indiscutible del ciberespacio.

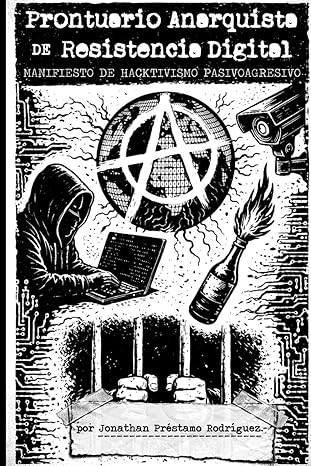

Prontuario Anarquista de Resistencia Digital

Se acaba de publicar «Prontuario Anarquista de Resistencia Digital», de Jonathan Préstamo Rodríguez, manifiesto de hacktivismo pasivoagresivo.

Vivimos en una época donde cada clic deja rastro, cada palabra se convierte en dato y cada gesto digital puede ser observado, analizado y utilizado. En este escenario, la libertad ya no depende sólo de las leyes o de las calles, también se juega en las redes, en los servidores y dentro de los algoritmos.

«Prontuario Anarquista de Resistencia Digital» es un manual de reflexión y práctica ética para comprender este nuevo territorio. No es un libro técnico de hacking ni un tratado académico sobre tecnología, sino una guía para quienes desean habitar el mundo digital con conciencia, autonomía y responsabilidad. Es un manifiesto de hacktivismo pasivoagresivo.

A lo largo de sus páginas, el lector encontrará ideas, principios y experiencias que recorren la historia del activismo digital, la ética del conocimiento libre, la organización de colectivos autónomos, la privacidad, la comunicación segura y las formas contemporáneas de protesta en la red. Todo ello desde una mirada libertaria y anarquista que entiende la tecnología no como un destino inevitable, sino como un campo de disputa política y cultural.

Este libro está dirigido a quienes sospechan que la red podría ser algo más que un mercado de datos, a quienes creen que el conocimiento debe compartirse y que la libertad digital es una práctica cotidiana, no un eslogan.

Porque resistir en el siglo XXI no significa abandonar la tecnología, sino reapropiarse de ella.